統一WebUI 操作ガイド

統一WebUI

![]()

概要

Unified Web Editor (旧Stable2go)は、Graydient's originalWebUI for creating AIimages, preloaded with popular open source AI models from ourcommunity.他のサービスとは異なり、「トークン」や「クレジット」は必要ありません。他のGraydient ツールと同様、Unified は無制限に使用でき、ロイヤリティ・フリーです。現在では、Fluxのように、多くのモデル・ファミリーをサポートしているため、名称を変更しました。

これらのモデルは何テラバイトものストレージと専用のグラフィック・アダプタを必要とするが、Graydient 、ウェブ上であればどこでも動作する。 Unifiedはすべてのデバイスで高速に動作し、ファイルはGraydient クラウド上で同期されます。

現在、FLUX と Stable Diffusion 3.5 のモデルが100以上用意されており、画像ごとに料金が発生しないので、無制限に楽しむことができます。 FLUX ビデオチュートリアル

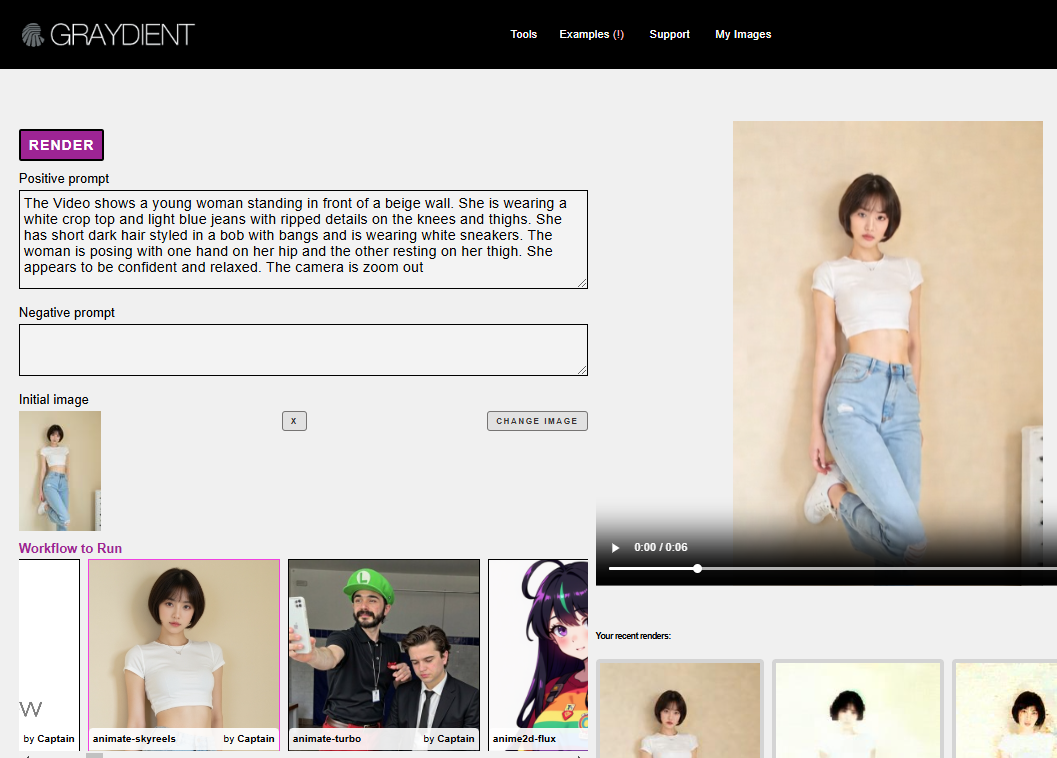

新着情報:ビデオ

新しい ワークフローを追加しました!ワークフローは「タスク」メニューの画像アップロードボタンとネガティブプロンプトのすぐ下にあります。

ビデオワークフロー

テキストからビデオへの変換、画像からビデオへの変換もサポートしています。

例えば、写真をビデオにすることができます。 その方法を紹介しよう:

- ユニファイド・エディターをクリック

- タスク>ワークフローをクリックし、アニメート・スカイリールを選択します(これが最新で、他にもあります)。

- プロンプトボックスの下にある「Initial Photo」と書かれたところに写真をアップロードしてください。

- そして、あなたのプロンプトを入力してください。 ビデオは2分以内に生成されます。

写真を必要としないTEXT-TO-VIDEOワークフローもある。

LTXとHUNYUANのビデオワークフローから選択し、communityHunYuan Loraライブラリからconcepts 追加することができます。

イメージワークフロー

ビデオと同じように、ワークフロー・エリアをクリックして作成を開始します。例えば、AIを使ってシームレスな繰り返しパターンを作る方法を学ぶことができます。これは、システムにある数多くのワークフローのほんの一例です。

ワークフローは初心者向け

シンプルなプロンプトから始め、1024×1024で一度に2つのimages 。

concepts システムはプロのために設計されている。

workflow から始める代わりに、ゼロから始めることもできる。concepts 、あなたが望むものを正確に得るためには、 システムの仕組みを完全に理解する必要があるので、これはちょっとしたウサギの穴です。この方法はより技術的ですが、より多くのパワーとcontrol を得ることができます。 Graydient ダッシュボードのインスピレーションセクションにある人気のプロンプトを編集することから始めることをお勧めします。

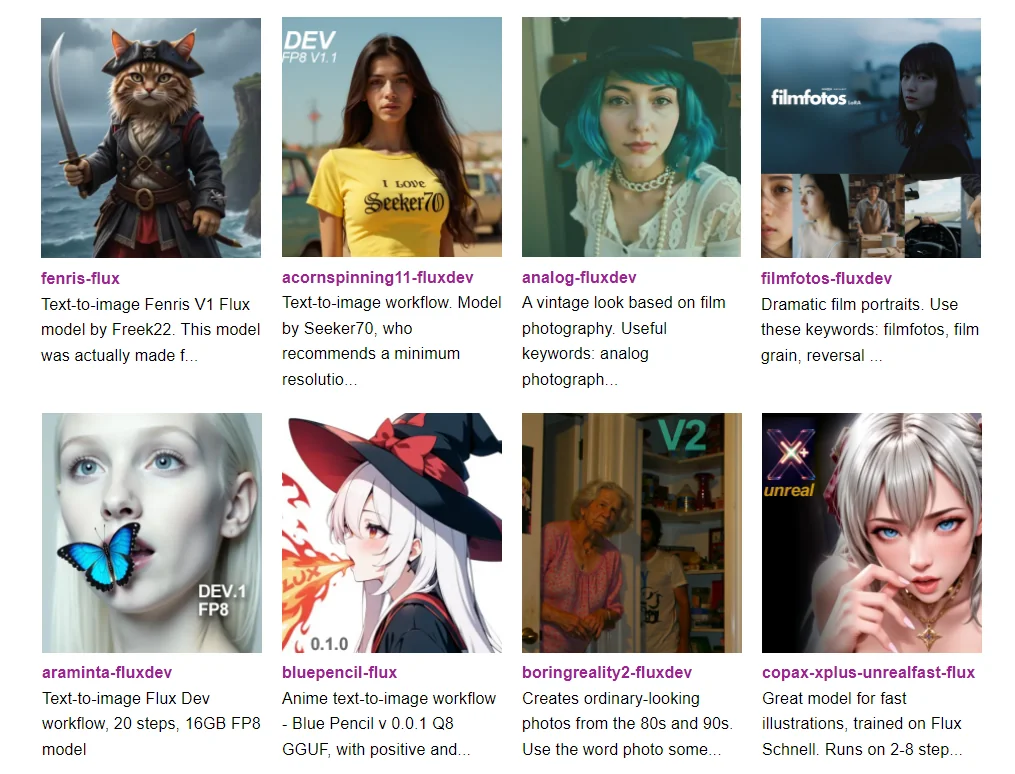

10,000以上のモデルがプリロードされており、起動に時間がかからない

毎週、新しいモデルを導入して います。concepts システムには、私たちのcommunity やウェブ上のあらゆるところから、訓練されたオリジナルのモデルが満載です。

プロンプトとは、AIにどのような画像を生成するかを指示する完全な記述である:

- リアルであるべき?アートワークの一種?

- 時間帯、視点、照明を描写する

- 被写体とその行動をよく描写する

- 最後に場所とその他の詳細を記述する

基本的な例:

映画のようなリアルな写真、ボサボサの犬が愚かな帽子をかぶって見る人を見ている、歩道の風景、ニューヨークのダウンタウン、タイムズスクエア、幸せ、ボケの背景、被写界深度、高画質、フィルムグレイン

迅速なプロンプトのヒント

1.常に全体像を描写する

プロンプトはチャットメッセージではない。各プロンプトは、前のターンに入力されたすべてを忘れて、システムでまったく新しいターンをする。例えば 、"a dog in a costume"(着ぐるみを着た犬)とプロンプトを出せば、必ずそれが返ってくる。 このプロンプトは完全に写真を描写しています。もし私たちが「それを赤くする」(不完全なアイデア)とだけプロンプトした場合、「それ」が持ち越されていないため、私たちは犬をまったく見ることができず、プロンプトは誤解されるでしょう。常に完全な指示を提示しましょう。

2.語順の問題

最も重要な言葉をプロンプトの最初に置きます。肖像画を作成する場合は、人物の外見と着ているものを最初に置き、次にその人物がどこにいるのかを最も重要でない詳細として置きます。

3.Length も重要である。

冒頭の単語が最も重要で、末尾に向かうにつれて各単語の注目度は低くなっていきます。しかし、私たちのシステム内の各AIconcept は異なる主題について訓練されているため、適切なconcept を選択することが、あなたの理解度に影響することを知っておく必要があります。 物事は要点を押さえて、システムを学ぶのが一番だ。 concepts システムを学習するのがベストです。

ポジティブなプロンプト

ポジティブ・プロンプトとネガティブ・プロンプトは、私たちが見たいものと見たくないものをAIに伝える言葉だ。人間は通常、このような二項対立の形ではコミュニケーションをとらないが、非常に騒がしい環境では、"これはダメだけど、あれはダメ!"と言うかもしれない。

ポジティブ澄んだ青い砂浜、ヤシの木がある昼間のビーチシーン

否定的: 人、ボート、ビキニ、NSFW

Stable2goエディターの2つのボックスにこのように入力します:

ポジティブなプロンプトには画像の主題とそれを支える詳細が含まれる。芸術style 、周囲の環境、美学への期待などを説明するのに役立つ。. 例

- 最高品質のリアルな子犬の写真

- ひまわりの傑作デッサン、ボケの背景

- 車道のスクーターのローアングル写真、水彩画

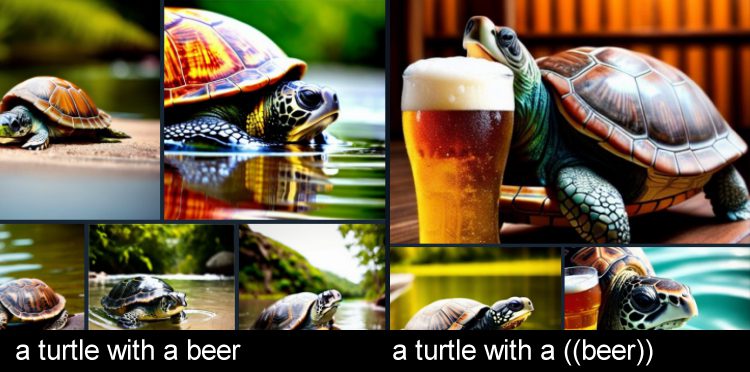

- /トルトゥーガをビールと一緒に*」と訳す。

- ビールと亀

ポジティブをより強力にする

特定の単語をより強調するには、入れ子になった括弧を加える。これにより、その倍率は1.1倍になる。

上の例では、"turtle "はプロンプトの最初に出てくるので、主語は "turtle "だと言っているが、"beer "はプロンプトの後半に出てくるが、同じように重要である。 ありそうもないシチュエーションを作るときには、特別な強調が役立ちます。

ネガティブプロンプト

ネガ画像に写って欲しくないものを描写する。

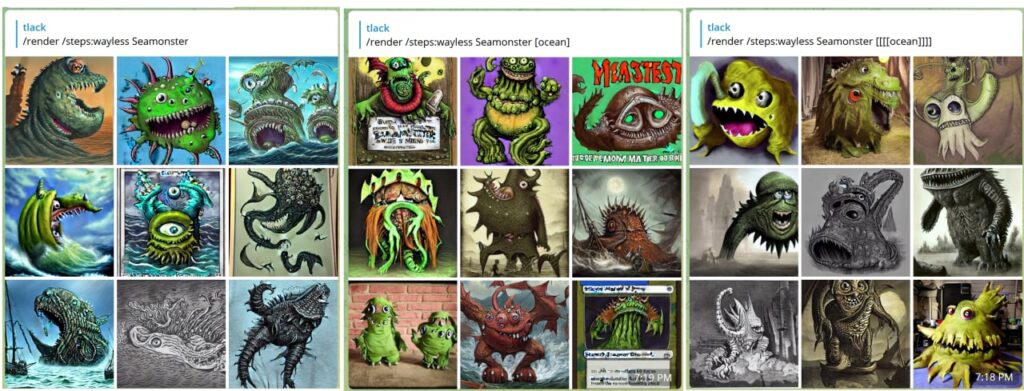

シーモンスターが欲しいが海は嫌だ、という人にはモンスターがお似合いだ。 ポジティブで、海は ネガティブ.

ネガはまた、余分な手足や解像度の低さなどを抑制することで、写真の質を高めることもできる。

ネガを強くする

括弧は1.1倍の強調になる。否定の場合は角括弧を使用する。

- (でも、こういうのはダメだ。

- (かわいい猫)最高品質[[[醜い猫、低解像度、低画質]]。

- 犬1匹(テリア、子犬)、ただし[猫、子猫、毛玉、ガーフィールド]は不可

- you can also call a negative concept [[<fastnegative-xl>]]

トラブルシューティング

guidance が 7 に設定されている場合、ネガが強く設定されすぎている可能性があります。 強度を下げてみてください。

かつてはポジティブとネガティブが、AIをこちらの望むように誘導する唯一の方法だったが、これはもう必要ない。代わりにconcepts を使ってください(下記) その他の例

Concepts

Concepts は、プロンプトだけではよく理解できない特定の事柄を生成する特殊なAIモデルである。複数のconcepts :通常、1つのベースモデルと1~3つのLoRasまたはInversionsを使用するのが一般的です。

モデルファミリー

当社のソフトウェアは、現在2つのStable Diffusionファミリーをサポートしています:SD15(古いモデルで、512×512でトレーニングされています)とStable Diffusion XL(ネイティブで1024×1024です)です。 これらの解像度に近づけることで、最良の結果を得ることができます。

最も注意しなければならないのは、ファミリーは互いに互換性がないということだ。SDXLベースはSD15ローラには使用できませんし、その逆も同様です。

種類Concepts

ベースモデルは「フルモデル」とも呼ばれ、画像のstyle を最も強く決定します。LoRasとTextual Inversionsは、微調整用の小さなモデルです。これらは1つの被写体、通常は人物やポーズに特化した小さなファイルです。インペイントモデルは、Inpaint と Outpaint ツールでのみ使用され、レンダリングやその他の目的には使用しないでください。

スペシャルconcept タグ

concepts システムはタグによって構成され、動物からポーズまで幅広いトピックがある。

Typeと呼ばれる特別なタグがあり、モデルがどのように振る舞うかを教えてくれます。また、PositivesとNegative Promptsの代わりに、DetailersとNegativeと呼ばれるものがあります。ネガティブconcept タイプを使用するときは、ウェイトもネガティブに設定することを忘れないでください。

Hyper」や「Turbo」のような速そうな名前のモデルは、render images 。 Guidance / CFG.

複数のブレンドconcepts: ウェイトを使う

concepts の隣に表示されるスライダーはウェイトと呼ばれる。ベースモデルは絵の具のキャンバスのようなもので、常に100%のウェイトを持っています。サポートする小さなモデルは、(マイナス)-2から2(最大)のウェイトの間で調整できます。通常、3つ以下のモデルを選択する場合は、0.4から0.7の間のウェイトが最適です。バランスを見ながら調整してください。

ネガティブモデルを使用する場合は、ウェイトをマイナス(通常は-1または-2)にスライドさせる。

少なくとも1つのベースを使用する

複数のベースモデルを追加することもできますが(使いやすくするため)、ベースは1つしか使えないので、不要なベースモデルは削除することを忘れないでください。ベースモデルはブレンドできないが、LoRaとInversionsはブレンドできる。 また、LoRaやTIをベース/フルモデルの代わりとして選択しないように注意してください。

トラブルシューティング

多くのモデルを使用することは、同時に多くの曲を演奏するようなものである。それらがすべて同じ音量(重さ)であれば、何かを選ぶことは難しい。

images が過度にブロック化されていたり、ピクセル化されているように見える場合は、ベース・モデルを使用し、guidance を 7 以下に設定し、ポジとネガが強すぎないようにしてください。ウェイトを調整して、最適なバランスを見つけましょう。Guidance とパラメータについては、以下のガイドを参照してください。

パラメータ

解像度幅と高さ

AIモデルの写真は特定のサイズで "訓練 "されているため、images 、そのサイズに近いものを作成するのが最良の結果を生む。あまり早く大きくしようとすると、不具合(双子、余分な手足)が生じる可能性がある。

ガイドライン

- 安定した拡散XLモデル:1,024×1,024からスタートし、通常は1,400×1,400以下が安全。

- Stable Diffusion 1.5は512×512でトレーニングされているため、上限は768×768となる。Photonのようないくつかの高度なモデルは、960×576で実行されます。その他のSD15サイズのヒント

- 4Kに近い2段階目のアップスケーリングはいつでも可能です。下記のFacelift アップスケーラー情報をご覧ください。

Seed

画像生成処理を初期化するための任意の番号。これは特定の画像ではなく(データベースの写真IDのようなものではない)、どちらかというと一般的な目印である。seed の目的は、画像プロンプトを繰り返すのを助けることです。Seed はもともと永続的な文字を維持するための最良の方法でしたが、Concepts システムに取って代わられました。

画像を繰り返すには、Seed 、Guidance 、Sampler 、Concepts 、プロンプトを同じにする。

Steps

AIが画像をrefine 、一般的にsteps 、より高い品質につながる反復回数。もちろん、ステップ数が多いほど処理は遅くなる。

昔のアドバイスでは、高画質を得るためには35steps 以上で作業するようにと言われていたが、最近の高効率モデルはわずか4steps で見事な画像を作成できるため、必ずしもそうではなくなってきている!

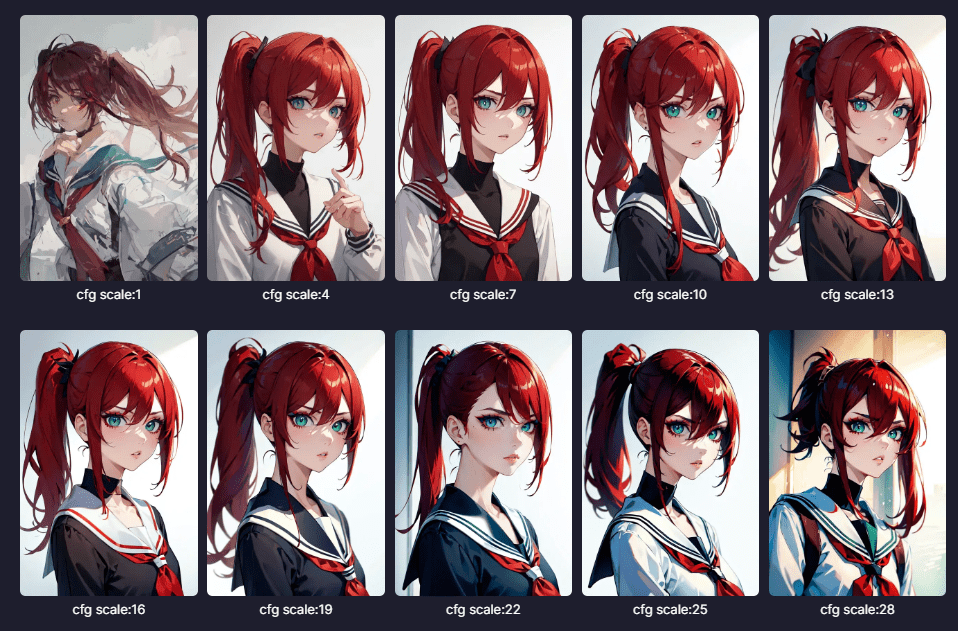

Guidance (CFG)。

(分類子を使わない)Guidance スケールは、AIがプロンプトにどれだけ忠実に従うかを制御するパラメータである。その範囲はSampler によって処理され、通常は0~30です。イラストやリアリズムに適した 7から始めることをお勧めします。

創造性とシャープさ

値を高くすると、よりプロンプトに忠実で、よりシャープなimages 。値が低いと、AIはより自由に空白を埋めることができ、おそらくより「創造的」な画像になります。AIに十分なguidance が与えられないと、ブロックが欠けたり、カラフルな文字が現れたりすることがあります。

この画像の違いを考えてみよう:

例外規定

一般的なモデルは、このguidance とステップパターンに従うが、最近の高効率モデルは、同じように機能するのに必要なguidance の数がはるかに少なく、1.5~2.5である。 これについては以下で説明する:

高効率モデル

低Steps, 低Guidance

ほとんどのconcepts 、素晴らしい画像を生成するにはguidance 7と35以上steps 。これは、より高効率のモデルが登場するにつれて変化している。

これらのモデルは、images を1/4の時間で作成することができ、guidance の低い4-12steps で済む。これらの モデルには ターボ、ハイパー、LCM 、ライトニング concepts とタグ付けされており、クラシックモデルと互換性があります。同じモデルファミリーのLorasやInversionsと一緒に使うことができます。SDXLファミリーが最も品揃えが豊富です(右端のプルダウンメニューを使用してください)。

Some of our favorite Lightning models are <boltning-xl> and <realvis4light-xl> which look great with a guidance of 2, steps between 4-12, and Refiner (no fix) turned off. Polish it off with a good negative like [[<fastnegative-xl:-2>]]. Follow it up with an upscale, and the effects are stunning!

使い方の詳細については、これらの特別なモデルタイプのノートをご覧ください。 エーテルバース-XL(下の写真)。guidance は2.5、steps は8。

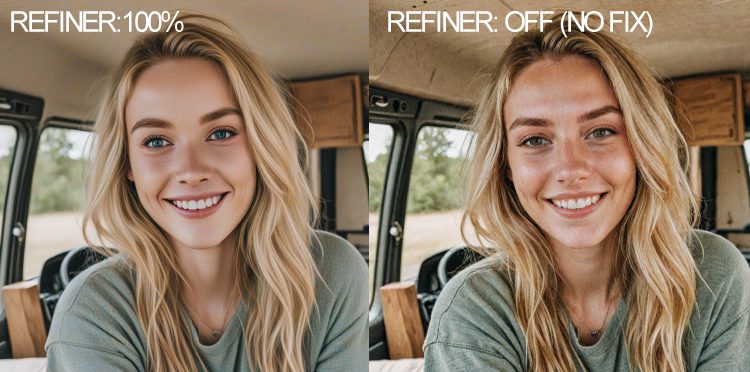

VASS(SDXLのみ)

VassはSDXL用のHDRmode で、構図を改善し、彩度を下げることができる。これを好む人もいれば、好まない人もいるでしょう。画像がカラフルに見えすぎる場合は、Refiner (NoFix) なしで試してみてください。

ロング・プロンプト・ウェイト(実験的)

オンにすると、肯定的および否定的なプロンプトを長く書くことができます。デモビデオを見る

例

((high quality, masterpiece, masterwork)) A wizard browsing through a magical marketplace with a mystical air around him. He has pointy ears, spectacles perched precariously on his nose, and a wand twirling in hsi hand. His robes are adorned with intricate patterns and patterns of magic dust. There is a bubbling magical cauldron, and mythical creatures peeking around from behind him.

これは、プロンプトの理解度を77のトークンよりもはるかに高めることができ、プロンプトの理解度を全体的に向上させる、プロンプトのバランス調整ユーティリティである。 もちろん、いくつかの不運なトレードオフがなければ、これを標準に設定するだろう:

制限事項

- 最良の結果を得るには、 guidance 、7 以下が必要。

- LPWは、非常に強い肯定的または否定的なプロンプトと組み合わせてはならない。

- (((((;゚Д゚))))))))))))

- [[[これもそうだろう]]]。

- ロラスやインバージョンとは相性が悪い。 concepts

- LPW はRemix ツールと100% 互換性があるわけではありません。

- では動作しない。LCM sampler

リファイナー(SDXLのみ)

リファイナーはノイズを除去し、滑らかにするテクニックで、絵画やイラストにおすすめです。よりきれいな色でより滑らかなimages 。しかし、時にはあなたが望むものとは正反対になることもあります。リアルなimages 、リファイナーをオフにすると、下図のように色とディテールが増します。その後、画像をアップスケールしてノイズを減らし、解像度を上げることができます。

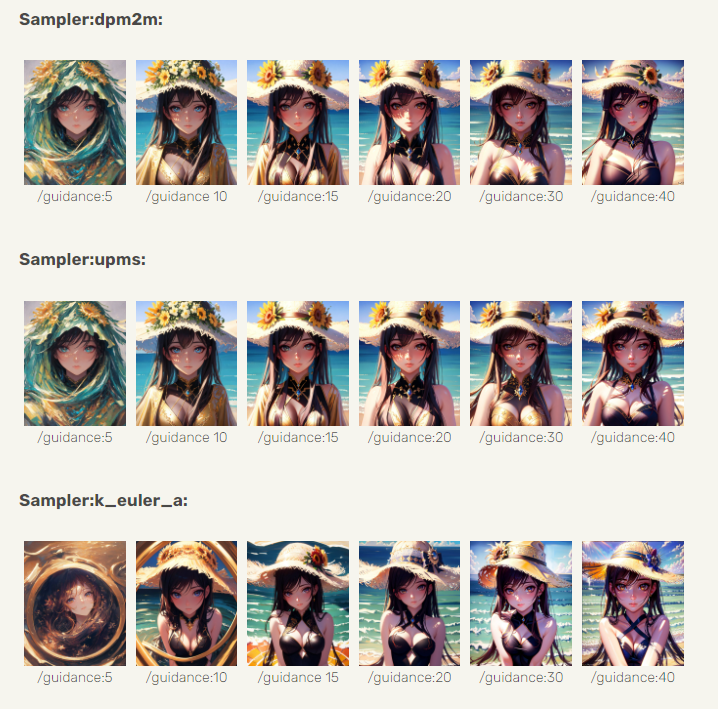

サンプラー

sampler (スケジューラとも呼ばれる)は、AIが与えられたパラメータでどのようにプロンプトを解くべきかを決定するアルゴリズムである。最高の」sampler は非常に主観的なものです。詳細と比較images

唯一の例外はLCM sampler で、これは特に低guidance および低steps でのレンダリングに使用される。

VAE

VAE はVariational AutoEncoderの略で、画像のカラフルさに大きな影響を与えるソフトウェアの一部である。SDXLには、現時点で素晴らしいVAE 。

SD15については、多くのオプションを用意している。その違いについて、ある人の非科学的な意見を紹介しよう:

- kofi2 - とてもカラフルで彩度が高い。

- blessed2 - コフィ2より飽和度が低い

- anything45 - blessed2より飽和度が低い。

- オレンジ - 中彩度、パンチのあるグリーン

- パステル - オランダの巨匠のような鮮やかな色彩

- ft-mse-840000-ema-pruned - リアリズムに最適。

プロジェクト

render images をプロジェクトフォルダに直接入れることができます。設定方法は以下の通り:

- まず、render プロジェクトを開始するための画像を用意します。

- MyGraydient> My をクリックする。Images

- を選択する。images

- 整理をクリック

- プロジェクトのプルダウンをクリックします。

- プロジェクトに名前をつける

- 最初の移動images

これでプロジェクトの準備は完了です。 フォルダ名を表示させるには、Stable2goをもう一度リフレッシュする必要があるかもしれません。

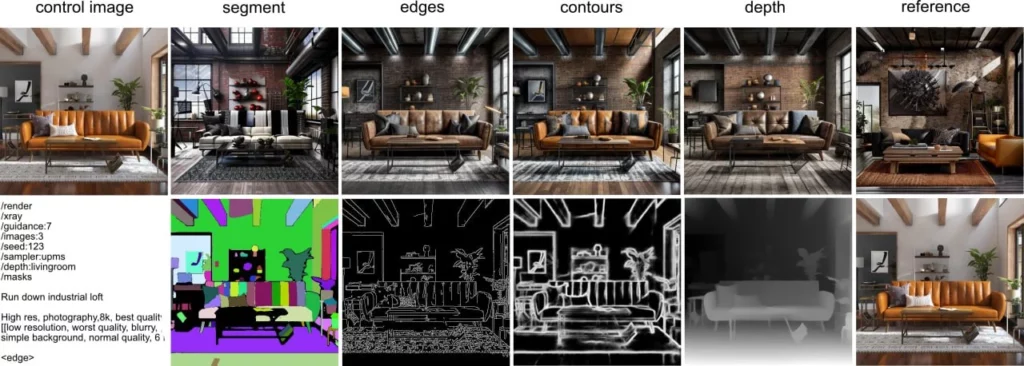

ControlNet

ControlNetはステンシルツールに似ており、多くのモードがあります。ステンシルとして開始画像を提供し、mode を選択し、正負のプロンプトでソース画像の外観を変更できます。ウェイト・スライダーで、control 。入力images 768×768または1400×1400の間が最適です。

その他のオプション

Stable2goにできることは、まだほんの一部です。また、PirateDiffusion's Cheat Sheetから任意のコマンドを追加することもできます。よく使われるのは /clipskip:2 です。

FreeU 、Adetailer 、Karras など、多くのオプションがサポートされている。 ウサギの穴は深い!

翻訳と制限

肯定的なプロンプトまたは他のフィールドに/translateを追加することにより、任意の言語でプロンプトを表示することができます。 システムは50言語をサポートしている。もちろん、地域の俗語は誤解される可能性があるので、翻訳機能を使用する場合は、できるだけ文字通りに、本通りにプロンプトしてください。例えば、"cubito de hielo "は、地域や文脈のニュアンスによって、スペイン語で小さな角氷を意味することもあれば、小さなペール缶のバケツの氷を意味することもある。公平を期すために、英語でもこのようなことが起こり得ます(極地での狩猟では火縄銃が置かれるかもしれません!)。このようなことが起こらないようにするには、肯定的なプロンプトと否定的なプロンプトで複数の単語を使用し、それをゼロにするのに役立ちます。

同等の生プロンプト

これは、AIに送信されるプロンプトの全文を示すデバッグメッセージである。

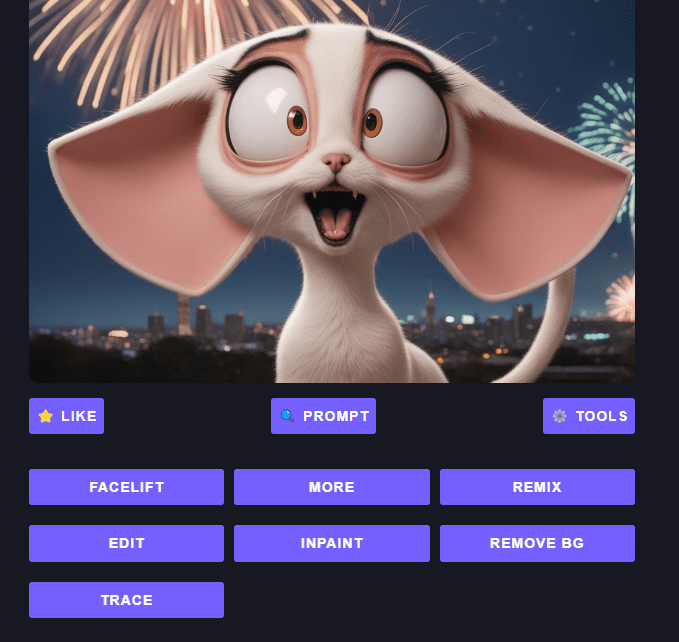

ツール

Refine あなたのimages

画像が作成されたら、画像内をクリックしてツールメニューを表示する。これらはスポット修正を作成するのに便利です。

Facelift 。

画素数とディテールを高める

スマートフォンのカメラに搭載されている「ビューティー」mode のように、画像のディテールを4倍にしたり、写真から線やシミを除去することができます。リアルな写真やアートワークのためのモード。 詳細

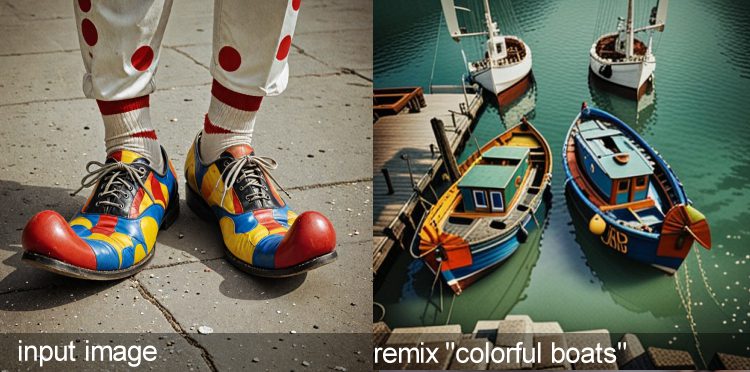

Remix 工具

画像から画像への変換

remix ツールは魔法のようだ。アップロードまたはレンダリングされた画像は、Remix ツールを使って、concept のアートstyle の中で変身させることができる。また、入力された写真を参考写真として使用し、劇的に異なる主題の変更に踏み込むこともできる。

Style 移籍とクリエイティブの "高級化"

また、remix ツールを使って、解像度の低いimages を新しいものに再解釈することもできます。たとえば、解像度の低いビデオゲームの写真を現代的でリアルなimages に変えたり、自分自身を風刺画やanime イラストに変えたりできます。このビデオではその方法を紹介します:

その他のツール

Moreツールは、同じ画像のバリエーションを作成します。

同じ被写体を少しずつ違うバリエーションで見るには、moreツールを使う。

フードの下で何が起こっているのか:元のプロンプトを保持したまま、seed の値が増加し、guidance がランダムになります。 制限事項:効率的なモデルを使用する場合、guidance 。

インペイントツール

別名ジェネレイティブ・フィル

インペインティングはマスキングツールで、ある領域の周囲にマスクを描き、そこに新しい何かを促したり、マジックイレーサーのようにオブジェクトを削除したりすることができる。inpaint ツールには、プラスとマイナスのプロンプトボックスがあり、以下のトリガーコードも受け付けます。 concepts.

注:このビデオ以降、私たちのソフトウェアは更新されましたが、同じ原則が適用されます。

BGツールを取り外す

高速バックグラウンド・ザッピング

背景除去ツールは、被写体の背後にあるものをすべて除去する簡単なワンステップソリューションです。Images 800×800あたりが最適です。また、インペイントツール(上)を使って、新しい背景をマスクしてプロンプトで配置することもできます。

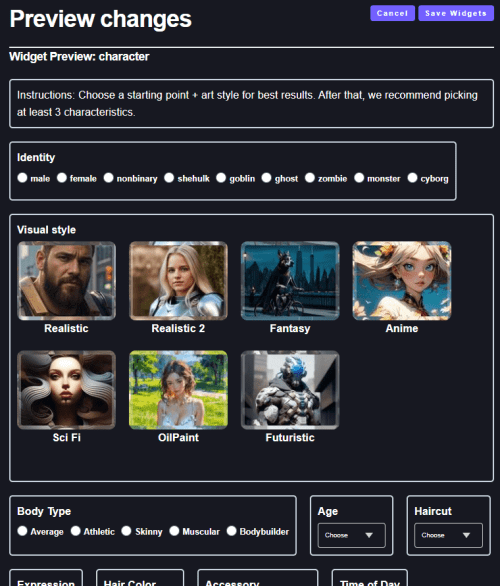

コードなしで独自のツールを構築

基本をマスターしたら、自分のWebUI (複数可)を作成することができる。

Stable2goウィジェットについてのビデオを見て、download ビルドを開始するテンプレート。コーディングは必要ありません!